در دنیای امروز وب، بهینهسازی موتورهای جستجو (SEO) نقش بسیار مهمی در جذب ترافیک وبسایتها و افزایش رتبه آنها در نتایج جستجو دارد. یکی از عوامل مهم در بهینهسازی سایت، استفاده صحیح از فایل Robots.txt است. در این مقاله، به معرفی فایل Robots.txt و کاربردهای آن میپردازیم.

این تصور را داشته باشید که برای انجام یک کار اداری، به سازمان بزرگی مراجعه میکنید که هیچ جایی را نمیشناسید. به دلیل اینکه مدیران این سازمان میدانند که مراجعه کنندگان همه جا را نمیشناسند، در ورودی یک باجه اطلاعات راه اندازی کردهاند و یک یا چند نفر را برای راهنمایی و نگهبانی مسئول قرار دادهاند. بدون این افراد، کل سازمان به هرج و مرج میافتد. برای انجام کارهای خود، هر فردی باید راهروهای پرتردد را طی کند و کارمندان نیز نمیتوانند به درستی و سرعت انجام دهند.

فایل Robots.txt در وبسایتها نقش مشابه راهنماها و نگهبانان دارد، با این تفاوت که برای رباتهایی است که به منظور بررسی سایت یا انجام کارهای دیگر، در بخشهای مختلف سایت حرکت میکنند و نه برای کاربرانی که به سایت دسترسی دارند.

تعریف فایل Robots.txt

فایل Robots.txt یک فایل متنی است که در ریشه سایت قرار میگیرد و دستوراتی را برای رباتهای جستجو (مانند گوگل بات) مشخص میکند. این فایل به رباتها اطلاع میدهد که کدام صفحات سایت قابل دسترسی هستند و کدام صفحات باید از ایندکس شدن جلوگیری شود.

ساختار فایل Robots.txt

فایل Robots.txt باید در ریشه سایت قرار بگیرد و برای هر سایت باید یک فایل مجزا وجود داشته باشد. ساختار این فایل به صورت زیر است:

User-agent: [نام ربات]

Disallow: [صفحاتی که باید از ایندکس شدن جلوگیری شوند]

Allow: [صفحاتی که مجاز به ایندکس شدن هستند]

Sitemap: [آدرس سایتمپ]

Crawl-delay: [تاخیر در دسترسی به صفحات]دستورالعملهای معمول در فایل Robots.txt

در فایل Robots.txt، میتوان از تعدادی دستورالعمل استفاده کرد. در ادامه به برخی از این دستورالعملها میپردازیم:

User-agent

این دستورالعمل برای مشخص کردن ربات جستجو استفاده میشود. معمولاً از “*” برای اشاره به همه رباتها استفاده میشود.

Disallow

این دستورالعمل به رباتها میگوید که صفحاتی که در آنها از این دستور استفاده شده، قابل دسترسی نیستند و باید از ایندکس شدن جلوگیری کنند.

Allow

با استفاده از این دستورالعمل، میتوان صفحاتی را که باید از ایندکس شدن محافظت شوند، مشخص کرد.

Sitemap

این دستورالعمل به رباتها آدرس سایتمپ را میدهد. سایتمپ یک فایل XML است که لیستی از صفحات سایت را برای رباتهای جستجو مشخص میکند.

Crawl-delay

این دستورالعمل میزان تاخیر در دسترسی به صفحات سایت را مشخص میکند. این دستور برای کاهش بار سرور و محافظت از سایت در مقابل حملات DDoS مفید است.

چرا باید فایل Robots.txt داشته باشیم؟

صاحبان وبسایت و وبمسترها، با استفاده از روشهای مختلف، میتوانند ورود رباتها به وبسایت را کنترل کنند. دلایل مختلفی برای این کنترل وجود دارد. به عنوان مثال، تمام صفحات یک سایت از درجه اهمیت یکسانی برخوردار نیستند و برخی صفحات ممکن است برای موتورهای جستجوگر مورد توجه نباشند. همچنین، بعضی صفحات ممکن است محتوای قابل قبولی نداشته باشند و صاحبان وبسایت ترجیح میدهند که رباتها به آنها دسترسی نداشته باشند. همچنین، اگر وبسایت شما دارای هزاران صفحه باشد و بازدید کل سایت هم زیاد باشد، ممکن است منابع سرور شما به دلیل بازدید پشت سر هم رباتها، مصرف شود.

در این موارد، فایل Robots.txt نقشآفرینی مهمی در کنترل ورود رباتها به وبسایت دارد. این فایل بهصورت اصلی برای محدود کردن درخواستهای بیش از حد بازدید از صفحات وبسایت استفاده میشود. به عبارت دیگر، با نوشتن دستورات مناسب در فایل Robots.txt، میتوانیم ورود رباتها به صفحات مختلف وبسایت را کنترل کنیم و از مصرف بیش از حد منابع سرور جلوگیری کنیم.

آشنایی با رباتهای گوگل

گوگل، به صورت خودکار با استفاده از چندین ربات خزنده (Crawler)، وبسایتها را اسکن می کند و صفحههای آنها را با دنبال کردن لینکهای موجود در صفحه به صفحه دیگر پیدا میکند. لیست زیر شامل مهمترین رباتهای گوگل است که باید آنها را بشناسید:

- ربات AdSense برای بررسی صفحات با هدف نمایش تبلیغات مرتبط

- ربات Googlebot Image برای بررسی تصاویر

- ربات Googlebot News برای ایندکس کردن سایتهای خبری

- ربات Googlebot Video برای بررسی ویدیوها

- ربات Googlebot که صفحات وب را کشف و ایندکس میکند و دو نسخه Desktop و Smartphone دارد

هر کدام از این رباتها به صورت مداوم، صفحههای وبسایت را بررسی میکنند. شما میتوانید در صورت نیاز هرکدام از رباتها را محدود کنید.

این که رباتهای خزنده هر چند وقت یک بار به سایت شما سر میزنند به چند فاکتور بستگی دارد. هر چه در طول روز تعداد بیشتری محتوا در وبسایتتان قرار بگیرد و تغییرات سایت اهمیت زیادی داشته باشد، رباتهای جستجوگر دفعات بیشتری به سایت شما مراجعه میکنند. برای مثال، در وبسایتهای خبری که همیشه در حال انتشار خبر و بهروزرسانی اخبارشان هستند رباتها با سرعت بیشتری صفحات را بررسی و ایندکس میکنند.

در سرچ کنسول بخشی به نام Crawl Stats وجود دارد که دفعات بررسی صفحههای سایت به صورت روزانه را نمایش میدهد. در همین صفحه، حجم دانلود شده توسط رباتها و همینطور زمان بارگذاری صفحهها را میتوانید ببینید.

کاربردهای فایل Robots.txt

فایل Robots.txt در بهینهسازی سایت و کنترل دسترسی رباتهای جستجو بسیار مهم است. در ادامه به برخی از کاربردهای این فایل میپردازیم:

جلوگیری از ایندکس شدن صفحات مشخص

با استفاده از فایل Robots.txt میتوان صفحات خاصی را از ایندکس شدن در موتورهای جستجو جلوگیری کرد. این عمل میتواند در مواردی که صفحات دوباره تولید میشوند یا صفحاتی که اطلاعات حساس دارند، مفید باشد.

کنترل دسترسی رباتهای جستجو

با استفاده از فایل Robots.txt میتوان دسترسی رباتهای جستجو به صفحات سایت را کنترل کرد. به عنوان مثال، میتوان صفحات موقتی را که تا زمان نهایی شدن آماده نیستند، مسدود کرد تا ترافیک اضافی به سرور نرود.

بهینهسازی سایت

فایل Robots.txt به وبمستران اجازه میدهد تا برخی از صفحات سایت را که میخواهند در نتایج جستجو نمایش داده نشوند، مشخص کنند. این کار میتواند به بهبود رتبه سایت در نتایج جستجو کمک کند.

مثالهای عملی از استفاده از فایل Robots.txt

برای بهتر درک کاربرد فایل Robots.txt، به برخی از مثالهای عملی آن میپردازیم:

مثال ۱: جلوگیری از ایندکس شدن صفحههای مدیریت

User-agent: *

Disallow: /wp-dmin/این مثال به همه رباتها میگوید که صفحات مربوط به مدیریت سایت (/wp-admin/) قابل دسترسی نیستند و باید از ایندکس شدن آنها جلوگیری کنند.

مثال ۲: مشخص کردن آدرس سایتمپ

User-agent: *

Sitemap: https://fanabyte.com/sitemap_index.xmlدر این مثال، آدرس سایتمپ سایت (https://fanabyte.com/sitemap_index.xml) به رباتها ارسال میشود.

راهنماییهای بهینهسازی فایل Robots.txt

برای بهینهسازی فایل Robots.txt و استفاده بهتر از آن، راهنماییهای زیر را در نظر بگیرید:

- حتماً فایل Robots.txt را در ریشه سایت قرار دهید.

- دقت کنید که دستورات درست و به شکل صحیح وارد شده باشند.

- مطمئن شوید که تمامی صفحات محتوای مهم سایت به درستی ایندکس شوند.

- از استفاده از دستورات Allow و Disallow به درستی برای کنترل دسترسی رباتها استفاده کنید.

- توجه کنید که فایل Robots.txt تأثیری در امتیاز SEO و رتبه سایت در موتورهای جستجو دارد، پس با دقت آن را بهینه کنید.

نکات مهم در استفاده از فایل Robots.txt

هنگام استفاده از فایل Robots.txt، به نکات زیر توجه کنید:

- فایل Robots.txt مخصوص رباتهای جستجو است و نقشی در محافظت از سایت در برابر نفوذ و حملات ندارد.

- برخی از رباتها ممکن است فایل Robots.txt را نادیده بگیرند و صفحات آنها را ایندکس کنند.

- فایل Robots.txt اطلاعات حساس را نباید در بر داشته باشد و صفحات محافظت شده باید به روشهای دیگر محافظت شوند.

محل فایل Robots.txt کجاست؟

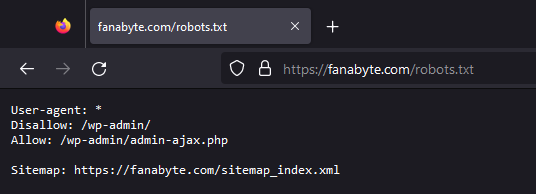

با داشتن ترغیب برای بررسی فایل robots.txt در وبسایت خود یا دیگر وبسایتها، پیدا کردن آن به راحتی امکانپذیر است.

تنها کافیست یک آدرس معمولی را در مرورگر خود باز کنید (به عنوان مثال fanabyte.com یا هر وبسایت دیگری) و در انتهای آدرس URL عبارت robots.txt/ را وارد کنید. با انجام این کار، فایل robots.txt در مرورگر شما نمایش داده میشود، مانند تصویر زیر:

با مطالعه فایل robots.txt سایتهای دیگر، میتوانید الگویی برای فایل مشابه در وبسایت خود ایجاد کنید.

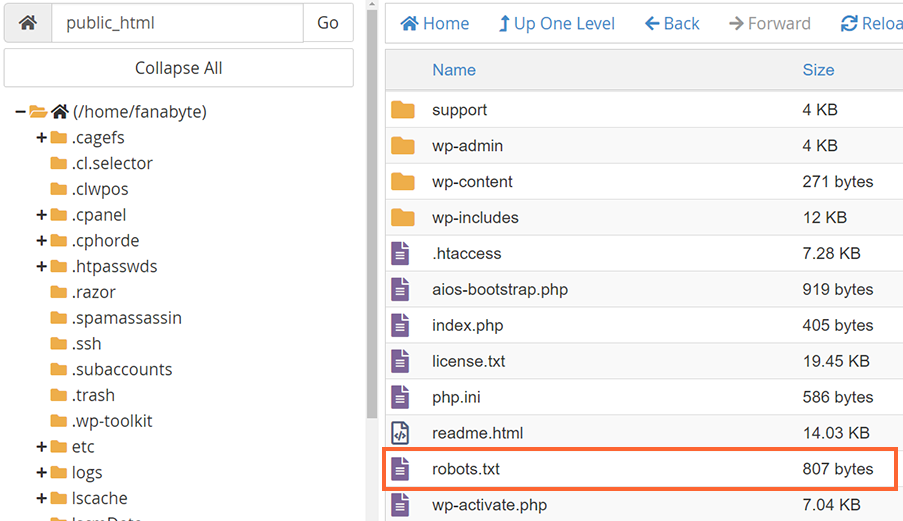

فایل robots.txt در قسمت Root وبسایت شما قرار دارد. برای دسترسی به دایرکتوری Root وبسایت، میتوانید به اکانت هاستینگ وبسایت خود وارد شوید و پس از ورود به قسمت مدیریت فایل، به فایل robots.txt دسترسی پیدا کنید. احتمالاً با یک صفحه مشابه تصویر زیر مواجه خواهید شد.

برای ویرایش فایل robots.txt خود، ابتدا آن را در دایرکتوری Root وبسایت خود پیدا کنید و سپس آن را باز کنید. سپس دستور جدید خود را وارد کرده و فایل را ذخیره کنید.

اگر فایل اصلی robots.txt در دایرکتوری Root وبسایت شما پیدا نشد، این ممکن است به دلیل این باشد که بعضی سیستمهای مدیریت محتوا به صورت خودکار یک فایل robots.txt مجازی ایجاد میکنند. در چنین حالتی، بهتر است یک فایل جدید برای وبسایت خود ایجاد کنید تا به همیشه به آن دسترسی داشته باشید.

ساخت فایل ربات

برای ساخت فایل robots.txt، نیازی به هیچ برنامهای خاص نیست. میتوانید از Notepad ساده ویندوز یا هر ویرایشگر متن دیگری که فایل خروجی از نوع TXT تولید میکند، استفاده کنید.

برای ساخت فایل robots.txt، فقط کافیست یک فایل جدید با فرمت txt ایجاد کنید و مطمئن شوید که فرمت و یا انکودینگ فایل به صورت UTF-8 باشد. سپس با باز کردن فایل، دستورات مورد نیاز برای robots.txt را طبق راهنماییهایی که قبلاً گفته شد، وارد کنید.

بعد از ساخت فایل robots.txt، باید آن را در سرور میزبان وبسایت آپلود کنید تا بتوانید از آن در وبسایت خود استفاده کنید.

نتیجهگیری

در این مقاله، با مفهوم و کاربرد فایل Robots.txt آشنا شدیم. فایل Robots.txt ابزاری مهم برای بهینهسازی سایت و کنترل دسترسی رباتهای جستجو است. با استفاده صحیح از این فایل، میتوانیم بهبودی در رتبه سایت در نتایج جستجو و کاهش بار سرور داشته باشیم.

FAQs (سوالات متداول)

۱. آیا فایل Robots.txt تأثیری در امتیاز SEO سایت دارد؟ بله، فایل Robots.txt میتواند تأثیری در امتیاز SEO و رتبه سایت در موتورهای جستجو داشته باشد. با استفاده صحیح از این فایل و کنترل دسترسی رباتهای جستجو، میتوان به بهبود رتبه سایت در نتایج جستجو کمک کرد.

۲. آیا رباتهای جستجو همیشه دستورات فایل Robots.txt را رعایت میکنند؟ خیر، برخی از رباتها ممکن است فایل Robots.txt را نادیده بگیرند و صفحاتی که باید از ایندکس شدن جلوگیری شود را همچنان ایندکس کنند. بنابراین، علاوه بر استفاده از فایل Robots.txt، باید روشهای دیگری برای محافظت از صفحات محتوای حساس سایت را نیز در نظر بگیرید.

۳. آیا فایل Robots.txt به تنهایی میتواند سایت را در برابر حملات محافظت کند؟ نه، فایل Robots.txt تأثیری در محافظت سایت در برابر حملات ندارد. این فایل صرفاً برای کنترل دسترسی رباتهای جستجو استفاده میشود. برای محافظت از سایت در برابر حملات، باید از روشهای دیگری مانند فایروال، تنظیمات امنیتی سرور و استفاده از روشهای رمزنگاری صفحات استفاده کنید.

۴. آیا فایل Robots.txt برای تمام رباتها یکسان است؟ دستورالعملهای فایل Robots.txt میتوانند برای هر ربات جستجو متفاوت باشند. با استفاده از دستورالعمل User-agent در فایل Robots.txt، میتوانید روباتها را مشخص کنید و دستورالعملهای خاص برای هر یک از آنها تعریف کنید.

۵. آیا فایل Robots.txt برای هر سایت لازم است؟ خیر، فایل Robots.txt برای هر سایت لازم نیست. اگر شما نیازی به کنترل دسترسی رباتهای جستجو به صفحات سایت خود ندارید، میتوانید از استفاده از این فایل صرفنظر کنید.